Akkulaufzeit bei IoT-Geräten: Was Datenblätter verschweigen und wie Entscheider die richtigen Fragen stellen

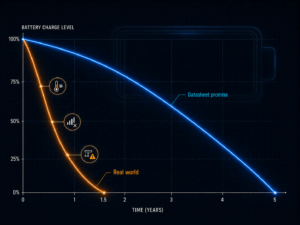

Das Datenblatt lügt nicht – aber es beschreibt eine Welt, die in der Praxis nicht existiert. Wer IoT-Tracker oder -Sensoren beschafft, sollte fünf Faktoren kennen, die über die echte Akkulaufzeit entscheiden.

Das Wichtigste in Kürze

- Die IoT Akkulaufzeit auf dem Datenblatt wird unter Laborbedingungen ermittelt – Raumtemperatur, perfektes Signal, minimale Sendefrequenz – und weicht in der Praxis oft erheblich davon ab.

- Fünf Faktoren bestimmen die reale Akkulaufzeit bei IoT-Geräten: Sendeintervall, Netzqualität und Retry-Verhalten, Schlafmodi (PSM und eDRX), Betriebstemperatur und Batteriechemie sowie die Wahl des Kommunikationsprotokolls (MQTT, CoAP oder LwM2M).

- Statt nach der Akkulaufzeit zu fragen, sollten Entscheider beim Anbieter ein Power Profile anfordern – eine Stromverbrauchskurve unter realen Bedingungen – und gezielt nach Exponential Backoff, PSM/eDRX-Unterstützung und konfigurierbarem Sendeintervall fragen.

Inhalt

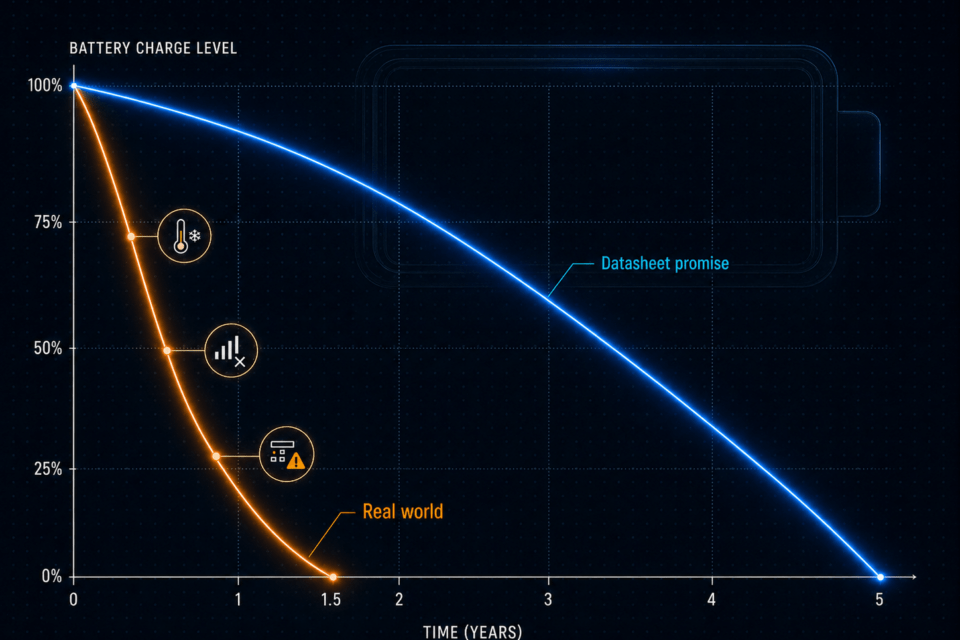

Ein Versprechen, das im Labor stimmt

Stellen Sie sich vor, Sie kaufen 300 Tracker für Ihr Lagerequipment, jeder mit einer versprochenen Batterielaufzeit von fünf Jahren. Achtzehn Monate später melden sich die ersten Geräte nicht mehr. Der Hersteller ist nicht schuld, technisch gesehen. Das Datenblatt war korrekt, nur eben unter Bedingungen ermittelt, die mit Ihrer Lagerhalle, Ihren Kühlzonen und Ihrem Mobilfunknetz wenig zu tun haben. Die IoT Akkulaufzeit ist eines der am häufigsten missverstandenen Versprechen der Branche.

Genau das ist das eigentliche Problem. Akkulaufzeit in IoT-Datenblättern wird unter Idealbedingungen berechnet: Raumtemperatur um 25 Grad Celsius, starkes Mobilfunksignal, ein Datenpaket pro Tag, Gerät ansonsten im Tiefschlaf. Eine Welt, in der Tracker auf einem Labortisch stehen, nicht auf einem Gabelstapler, der zwischen Außenlager und Tiefkühlzone pendelt.

Stellschraube 1: Sendeintervall optimieren – der direkteste Hebel für längere IoT Akkulaufzeit

Wie oft ein Gerät seinen Standort oder Messwert überträgt, ist der direkteste Faktor für den Energieverbrauch. Jede Übertragung kostet: GPS-Fix anfordern, Mobilfunkmodul aufwecken, Verbindung aufbauen, Daten senden, Verbindung wieder abbauen. Das klingt nach wenigen Millisekunden, addiert sich aber über Monate erheblich.

Ein Tracker, der alle 5 Minuten sendet, verbraucht nicht sechsmal so viel Energie wie einer, der alle 30 Minuten sendet. Die Energiemathematik ist ungünstiger, weil jede Verbindung einen Anlaufstrom kostet, der überproportional zu Buche schlägt. In der Praxis kann die Umstellung von 5- auf 30-Minuten-Intervalle die Laufzeit vervielfachen – ohne eine einzige Hardware-Änderung.

Die entscheidende Frage vor dem Kauf ist deshalb: Ist das Sendeintervall frei konfigurierbar, und was steht im Datenblatt als Grundlage der Laufzeitangabe? Steht dort „1 Übertragung pro 24 Stunden“ und Ihr Use Case erfordert Tracking alle 15 Minuten, können Sie die versprochenen fünf Jahre durch vier teilen.

Stellschraube 2: Schlechtes Mobilfunksignal als Akkukiller – Retry-Verhalten und Exponential Backoff

Mobilfunkmodule in IoT-Geräten sind geduldige Optimisten. Findet ein Gerät kein ausreichendes Netz, versucht es es einfach nochmal. Und nochmal. Und nochmal. Jeder dieser Versuche zieht Strom, teilweise deutlich mehr als eine erfolgreiche Verbindung, weil das Modul bei schlechtem Empfang die Sendeleistung erhöht.

Das ist kein Design-Fehler, sondern Physik. Problematisch wird es, wenn die Firmware keine intelligente Bremse eingebaut hat. Gute Implementierungen nutzen einen Mechanismus namens Exponential Backoff: Nach jedem Fehlversuch verdoppelt sich die Wartezeit vor dem nächsten Versuch. Schwächere Implementierungen senden dagegen im Sekundentakt weiter, bis die Batterie leer ist.

Für die Beschaffung bedeutet das: Fragen Sie explizit nach dem Retry-Verhalten der Firmware. Wie verhält sich das Gerät bei dauerhaft schlechtem Signal? Gibt es eine Obergrenze für Versuche? Kann das Gerät bei Verbindungslosigkeit in den Tiefschlaf wechseln, statt endlos zu suchen?

Was ist „Exponential Backoff“?

- Wenn ein IoT-Gerät keine Netzverbindung aufbauen kann, versucht es es erneut. Die Frage ist: wie schnell? Einfache Firmware wiederholt den Versuch in festen Abständen, etwa alle 30 Sekunden, bis eine Verbindung steht oder die Batterie leer ist.

- Exponential Backoff ist ein klügeres Prinzip: Nach jedem Fehlversuch verdoppelt sich die Wartezeit vor dem nächsten. Erster Versuch schlägt fehl: 30 Sekunden warten. Zweiter schlägt fehl: 60 Sekunden. Dann 2 Minuten, 4 Minuten, 8 Minuten. Ab einem konfigurierten Maximum, zum Beispiel einer Stunde, bleibt der Abstand konstant.

- Das spart Energie, weil das Modem in den Wartephasen schläft statt zu senden. Und es entlastet das Netz, weil Tausende Geräte nach einem Ausfall nicht gleichzeitig im Sekundentakt versuchen, sich neu zu verbinden.

- Für Entscheider relevant: Ob ein Gerät Exponential Backoff unterstützt, steht selten im Datenblatt. Es ist eine Firmware-Eigenschaft, die man beim Hersteller explizit erfragen muss.

Stellschraube 3: PSM und eDRX – wie NB-IoT und LTE-M die Akkulaufzeit verlängern

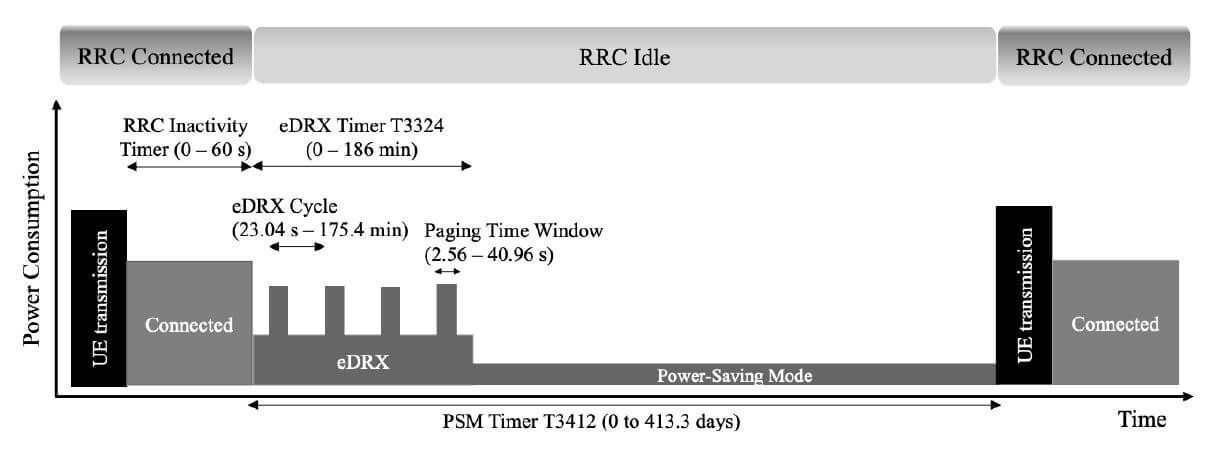

Wer IoT-Geräte auf Basis von NB-IoT oder LTE-M, den beiden dominierenden Mobilfunkstandards für stromsparende IoT-Anwendungen, betreibt, hat Zugang zu zwei standardisierten Energiesparmechanismen: PSM und eDRX.

PSM steht für Power Saving Mode und funktioniert wie Tiefschlaf. Das Gerät meldet dem Netz, wann es wieder aufwacht, und wird bis dahin komplett vom Netz abgekoppelt. Der Strombedarf im PSM-Modus ist minimal. NB-IoT-Geräte können in PSM bis zu 310 Stunden schlafen, bevor sie sich kurz melden und wieder einschlafen. Für Anwendungen, die nur einmal täglich oder einmal pro Stunde Daten liefern müssen, ist das ideal.

eDRX, Extended Discontinuous Reception, ist das Pendant für Geräte, die etwas erreichbarer bleiben müssen. Statt dauerhaft auf Nachrichten zu lauschen, schläft das Gerät auch hier, wacht aber in konfigurierbaren Abständen kurz auf, um zu prüfen, ob eine Nachricht vorliegt. Leichterer Schlaf, weniger Energieersparnis als PSM, aber mehr Reaktionsfähigkeit.

Verbindungsszustände und Energieverbrauch eines IoT-Devices mit eDRX und PSM unter NB-IoT. Quelle: „PSM und eDRX“, 1NCE

Telit beschreibt, dass ein LTE-M-Gerät, das einmal täglich sendet und alle zehn Minuten kurz aufwacht, auf zwei handelsüblichen AA-Batterien eine Laufzeit von etwa 4,7 Jahren erreichen kann. Das ist kein Laborszenario, sondern ein realistischer Wert für viele Industrie-Use-Cases – vorausgesetzt, PSM und eDRX sind richtig konfiguriert.

Der Haken: Beide Modi müssen vom Netzbetreiber unterstützt werden und auf dem Gerät aktiviert sein. In der Praxis ist das keine Selbstverständlichkeit. Fragen Sie deshalb Ihren Netzbetreiber explizit, ob PSM und eDRX in Ihrem Netz verfügbar sind, bevor Sie Hardware auf diese Annahme hin kaufen.

Stellschraube 4: Temperatureffekte auf IoT-Batterien – Li-Ion vs. Li-SOCl₂

Lithium-Ionen-Akkus, wie sie in den meisten kompakten IoT-Geräten stecken, mögen es gemäßigt. Bei minus 20 Grad Celsius verlieren sie nach Angaben von Experten aus der Branche 20 bis 40 Prozent ihrer Kapazität im Vergleich zu Raumtemperatur. Ein Gerät mit 10.000 mAh auf dem Datenblatt hat bei Tiefkühlbedingungen effektiv noch 6.000 bis 8.000 mAh.

Für Anwendungen in Kühllager, Außenbereich in nordeuropäischen Klimazonen oder Transportketten mit Temperaturschwankungen empfehlen sich Lithium-Thionylchlorid-Zellen, kurz Li-SOCl₂. Diese Batteriechemie ist unempfindlicher gegenüber Kälte und wird in industriellen IoT-Anwendungen häufig für genau diese Szenarien eingesetzt.

Wie Qoitech in einer Analyse von Batterie-Datenblättern feststellt, gibt es außerdem einen Unterschied zwischen Dauerentladung und Impulsbelastung, der auf den meisten Datenblättern gar nicht abgebildet wird. IoT-Geräte entladen Batterien in Pulsen, nicht kontinuierlich. Manche Batterietypen kommen damit besser zurecht als andere.

Stellschraube 5: MQTT, CoAP und LwM2M – welches Protokoll schont die IoT-Batterie?

PSM und eDRX bestimmen, wie oft ein Gerät mit dem Netz spricht. Was bei jedem einzelnen Gespräch tatsächlich über die Leitung geht, bestimmt das Kommunikationsprotokoll. Und auch hier gibt es erhebliche Unterschiede.

MQTT, das Message Queuing Telemetry Transport-Protokoll, ist seit 1999 der de-facto-Standard für IoT-Kommunikation und in vielen Cloud-Plattformen wie AWS oder Azure fest verankert. Es funktioniert nach dem Publish/Subscribe-Prinzip: Geräte veröffentlichen Nachrichten auf einem zentralen Broker, der sie an alle Interessenten weiterleitet. MQTT läuft über TCP, ein verbindungsorientiertes Transportprotokoll, das jeden Empfang bestätigt. Zuverlässig, aber nicht schlank.

CoAP, das Constrained Application Protocol, wurde als leichtgewichtige Alternative für ressourcenbeschränkte Geräte entwickelt. Es setzt auf UDP, also ein verbindungsloses Protokoll, das Datenpakete ohne Empfangsbestätigung verschickt. Das reduziert den Overhead, also die Datenmenge, die jenseits der eigentlichen Nutzdaten übertragen wird, erheblich. In einem Praxistest von 1NCE, dokumentiert in ihrer Blogreihe zu schlanken Protokollen im LPWAN, reduzierte der Wechsel von MQTT zu CoAP den Energieverbrauch je nach Paketgröße um 14 bis 48 Prozent.

LwM2M, Lightweight Machine-to-Machine, baut auf CoAP auf und erweitert es um standardisierte Funktionen für das Gerätemanagement: Firmware-Updates aus der Ferne, Konfigurationsänderungen, Statusüberwachung. Es gilt als moderne Weiterentwicklung von MQTT für professionelle, skalierbare IoT-Flotten, wird aber noch nicht von allen Cloud-Plattformen vollständig unterstützt.

Für Entscheider bedeutet das: Die Protokollfrage ist keine rein technische Entwicklerentscheidung. Sie beeinflusst direkt die Akkulaufzeit und damit die Betriebskosten über die gesamte Laufzeit einer Flotte. Fragen Sie beim Anbieter nach, welches Protokoll das Gerät nutzt, ob es konfigurierbar ist, und ob CoAP oder LwM2M als Option zur Verfügung stehen.

IoT Akkulaufzeit realistisch einschätzen: Die richtigen Fragen an den Anbieter

Die Akkulaufzeit auf dem Datenblatt ist ein Ausgangspunkt, kein Versprechen. Wer Hardware für eine mehrjährige Flotte beschafft, sollte mindestens diese Fragen stellen:

Bei welchem Sendeintervall wurde die Laufzeitangabe ermittelt? Unterstützt die Firmware Exponential Backoff bei Verbindungsproblemen? Sind PSM und eDRX implementiert und konfigurierbar? Welche Batteriechemie ist verbaut, und für welchen Temperaturbereich ist sie ausgelegt? Welches Kommunikationsprotokoll nutzt das Gerät, und lässt es sich auf CoAP oder LwM2M umstellen?

Und dann noch eine Frage, die viele Hersteller überrascht: „Können Sie uns ein Power Profile zeigen?“ Ein Power Profile ist eine Kurve, die den Stromverbrauch des Geräts über einen repräsentativen Zeitraum zeigt, also nicht nur die Spitzenwerte beim Senden, sondern auch den Ruhestrom im Schlaf, die Anlaufphase beim GPS-Fix, das Verhalten bei schlechtem Netz. Seriöse Hersteller haben diese Daten. Wer sie nicht liefern kann oder will, sagt damit schon etwas aus.

Akkulaufzeit ist, und das ist der eigentliche Kern dieser ganzen Diskussion, kein Hardware-Merkmal. Sie ist ein Systemergebnis. Hardware, Firmware, Netzanbindung und Einsatzumgebung wirken zusammen. Das Datenblatt beschreibt nur einen dieser fünf Faktoren, und das auch noch unter Bedingungen, die mit Ihrem konkreten Projekt oft wenig gemein haben.