Das Ende der billigen KI und die Folgen für vernetzte Geräte

OpenAI und Anthropic kämpfen mit Engpässen, steigenden Preisen und zu vielen Ausfällen. Für Teams, die smarte Geräte auf Cloud-KI aufgebaut haben, wird das gerade zum handfesten Problem – und zum Anlass, eine längst fällige Frage zu stellen: Wie abhängig wollen wir eigentlich sein?

Das Wichtigste in Kürze

- OpenAI verfehlte laut Wall Street Journal seine internen Nutzerziele für 2025 und kämpft mit nachlassendem Umsatzwachstum, während Anthropic die Preise erhöht und Geschäftskunden künftig nach tatsächlichem Verbrauch statt nach Pauschale abrechnet.

- IoT-Projekte, die für KI-Auswertungen auf externe Cloud-Dienste angewiesen sind, tragen damit ein Risiko, das lange unterschätzt wurde: Ausfälle, höhere Kosten und keine Kontrolle über die eigene Infrastruktur.

- KI direkt auf dem Gerät zu betreiben, statt dafür jedes Mal die Cloud zu fragen, wechselt 2026 von der Nische in den Mainstream – nicht nur aus technischen Gründen, sondern weil die Kostenrechnung kippt.

Ein Riss im Fundament

Wer dieser Tage den Wall Street Journal-Bericht über OpenAI (€) liest, bekommt das Bild eines Unternehmens, das unter dem Gewicht seiner eigenen Ambitionen zu ächzen beginnt. Das Ziel, bis Ende 2025 eine Milliarde wöchentlich aktiver ChatGPT-Nutzer zu erreichen, wurde verfehlt. Der Jahresumsatz blieb hinter internen Zielen zurück. CFO Sarah Friar soll intern Zweifel geäußert haben, ob die eingegangenen Rechenzentrumsverträge von rund 600 Milliarden Dollar überhaupt finanzierbar bleiben.

Das klingt nach einer Geschichte für Investoren. Für IoT-Entwickler ist es aber mehr als das.

Denn zur gleichen Zeit zeigen sich bei Anthropic, dem stärksten Konkurrenten im Unternehmensgeschäft, ähnliche Probleme. Bis Anfang April 2026 erreichte Anthropics Dienst eine Verfügbarkeit von 98,95 Prozent. Das klingt gut, ist es aber nicht. Hochgerechnet auf ein Jahr wären das rund 90 Stunden Ausfall, verglichen mit den 50 Minuten, die professionelle Cloud-Anbieter als Standard garantieren. Retool-Gründer David Hsu wechselte laut Wall Street Journal deswegen von Anthropic zu OpenAI. Dass er dabei vom Regen in die Traufe geraten könnte, ist nicht ausgeschlossen.

Wer die Rechnung bisher bezahlt hat

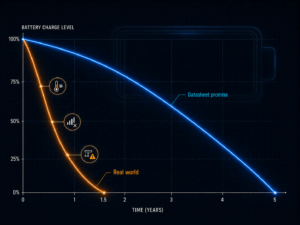

KI-Dienste waren in den letzten Jahren erstaunlich günstig. Das war kein Zufall, sondern eine Entscheidung: Investoren subventionierten niedrige Preise, um möglichst schnell viele Nutzer zu gewinnen. 404media vergleicht das treffend mit Uber in den frühen Jahren, als jede Fahrt günstiger angeboten wurde, als sie kostete. Irgendwann endet das. Bei KI-Diensten ist dieses Irgendwann gerade eingetroffen.

Anthropic hat seine Geschäftskunden bereits auf Verbrauchsabrechnung umgestellt. Statt einer monatlichen Pauschale zahlen sie künftig nach tatsächlicher Nutzung. Gleichzeitig sind die Preise für Rechenkapazität stark gestiegen: Mieten für moderne KI-Chips verteuerten sich laut Branchenberichten in nur zwei Monaten um 48 Prozent, ein anderer großer Anbieter erhöhte seine Preise um mehr als 20 Prozent. Auch GitHub schränkte den Zugang zu seinem KI-Programmierwerkzeug Copilot ein und stoppte vorübergehend neue Anmeldungen.

Wer seine KI-Kosten bisher auf Basis der alten Preise kalkuliert hat, sitzt auf einem Risiko.

Warum vernetzte Geräte das besonders spüren

Vernetzte Systeme haben eine unangenehme Eigenschaft: Sie laufen durch. Kein Nutzer, der kurz wartet, keine Fehlermeldung, die man einfach wegklickt. Ein Sensor, der alle 30 Sekunden Messwerte schickt und diese zur Auswertung an einen Cloud-Dienst weiterleitet, hat kein Konzept für den Fall, dass dieser Dienst plötzlich nicht mehr erreichbar ist oder zehnmal so viel kostet.

Die Abhängigkeit ist in vielen Projekten still gewachsen, ohne je als Risiko benannt zu werden. Cloud-KI war günstig, gut dokumentiert und wurde von Jahr zu Jahr leistungsfähiger, ohne dass man selbst etwas tun musste. Das war bequem. Unternehmen, die heute KI-gestützte Abläufe auf dieser Basis betreiben, tun das zu Preisen, die strukturell nicht haltbar sind – und könnten eines Tages feststellen, dass ihre Kosten sich vervielfacht haben oder der Zugang schlicht eingeschränkt wird.

Für IoT-Projekte sind drei Szenarien dabei besonders heikel: Systeme, die in Echtzeit reagieren müssen und keinen Umweg über die Cloud verkraften. Systeme, bei denen ein Ausfall des KI-Dienstes den gesamten Betrieb lahmlegt. Und Projekte, bei denen mit steigender Gerätezahl die Kosten überproportional wachsen.

KI direkt auf dem Gerät: Vom Experiment zum Standard

Die Antwort auf Cloud-Abhängigkeit ist nicht neu, aber sie wird gerade ernsthafter diskutiert als je zuvor: KI-Auswertungen direkt auf dem Gerät oder in einem lokalen Netzwerkknoten durchführen, statt dafür jedes Mal einen externen Dienst zu kontaktieren. Das spart nicht nur Geld und Latenzzeit – also die Verzögerung zwischen Anfrage und Antwort – sondern macht Systeme auch unabhängiger von der Zuverlässigkeit externer Anbieter.

Laut einer Analyse von IoT Tech News verlassen Geräte mit eingebetteter KI 2026 die Phase der Pilotprojekte und tauchen in normalen Produktportfolios auf. Der Zeitpunkt ist kein Zufall. Der Marktforschungsdienst IDC beschreibt den Trend als strukturell: KI-Rechenzentren beanspruchen einen wachsenden Teil der weltweit verfügbaren Chip-Produktion, was die Kosten für alle treibt – auch für die Hersteller kleiner IoT-Hardware.

Dell-Architekt Daniel Cummins zitiert in einem Blogbeitrag vom Januar 2026 Dell-CTO John Roese mit der Einschätzung, dass das lokale Betreiben von KI-Modellen zur Norm werden werde, um Unternehmen vor externen Störungen zu schützen. Für zeitkritische Anwendungen – Maschinensteuerung, medizinische Geräte, autonome Systeme – sei eine Abhängigkeit von der Cloud ohnehin keine Option. Aber der Punkt gilt zunehmend auch für weniger kritische Projekte, sobald man die tatsächlichen Kosten und Risiken ehrlich aufschreibt.

Drei Fragen, die jetzt gestellt werden sollten

Das ist keine Aufforderung, alle Cloud-KI-Dienste sofort abzuschalten. Für rechenintensive Aufgaben, seltene Auswertungen oder das Training neuer Modelle bleiben externe Dienste sinnvoll. Aber drei Fragen sollte jedes Team, das KI in vernetzte Produkte einbaut, jetzt ehrlich beantworten.

- Was passiert mit meinem System, wenn der KI-Dienst zwei Stunden ausfällt? Wenn die Antwort unbefriedigend ist, liegt ein Architekturproblem vor, kein Betriebsproblem.

- Wie entwickeln sich meine Kosten, wenn zehnmal so viele Geräte den Dienst nutzen wie heute? Viele Projekte wurden zu Preisen kalkuliert, die möglicherweise nicht dauerhaft gelten.

- Welche KI-Aufgaben brauchen wirklich einen leistungsstarken externen Dienst, und welche könnten ein kleineres, lokal laufendes Modell erledigen? Für viele typische IoT-Aufgaben – Anomalieerkennung, Klassifizierung, Mustererkennung – reichen schlanke, spezialisierte Modelle auf dem Gerät völlig aus.

Die aktuelle Krise bei den großen KI-Anbietern ist kein vorübergehender Engpass. Sie ist das Ergebnis einer Preisstrategie, die auf schnelles Wachstum statt auf langfristige Tragfähigkeit ausgerichtet war. Für alle, die smarte Geräte bauen, ist das ein guter Moment, Abhängigkeiten zu überprüfen, die sich in den letzten Jahren bequem und fast unbemerkt angesammelt haben.